Научно-исследовательский проект Google Brain разработал два искусственных интеллекта (ИИ), которые развили собственный криптографический алгоритм для защиты сообщений от стороннего ИИ, который пытался разработать метод взлома созданного ИИ Google шифра. Исследование прошло успешно: первые два ИИ моментально научились безопасно передавать сообщения.

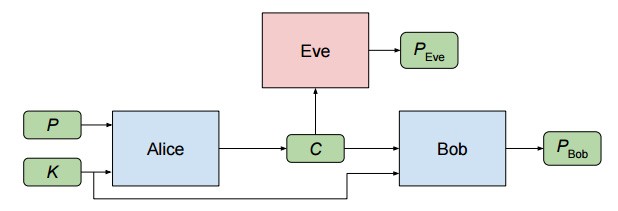

Структура криптографической системы. P – исходный входящий текст, K – общий секретный ключ, С – закодированный текст, PEve и PBob – вывод декодированного текста (computed plaintext outputs)

Команда Google Brain (работающая в Маунтин-Вью, независимо от лондонской Deep Mind) начала с довольно стандартных нейронных сетей, названных Элис (Alice), Боб (Bob) и Ева (Eve). У каждой нейронной сети была своя особая задача: Элис должна была отправить защищенное (кодом) сообщение Бобу, Боб должен попытаться декодировать сообщение, а Ева должна была перехватить сообщение и попытаться декодировать его. У Элис и Боба было одно преимущество по сравнению с Евой: у них изначально был общий секретный ключ (т.е. симметричное шифрование).

Важно отметить, что ИИ не были обучены ни декодированию, ни криптографическим техникам: им была задана только функция потерь (условие разрушения), с которой они и работали. В случае Евы функция потерь была проста: расстояние между исходным входящим тестом Элис и предположениями относительно него, измеряемое верными и неверными битами. Функция потерь для Элис и Боба была немного сложнее: если предположение Боба (опять же измеряемое в битах) было слишком далеко от исходного входящего текста, оно считалось неудачным; для Элис, если попытки Евы были лучше случайного угадывания, они засчитывались как неудачные. И таким образом была создана генеративная соперничающая сеть, или GAN (от англ. Adversarial generative network).

У Элис, Боба и Евы общая «соединительно-трансформирующая» архитектура нейронной сети, но они были инициализированы независимо друг от друга, и между ними нет никакой связи за исключением общего ключа у Элис и Боба. Для Элис ключ и исходный текст вводятся в первый слой нейронной сети, для Боба ключ и зашифрованный текст были введены, что касается Евы, у нее есть только зашифрованный текст. Первый слой полносвязный, поэтому текст и ключ могут там смешаться. За первым слоем следуют несколько сверточных слоев, которые учатся применять функцию к битам, которые были переданы предыдущим слоем. Они не знают, какой может быть эта функция; они просто учатся в процессе. Элис получает зашифрованный текст, который выдает последний слой; Боб и Ева выдают то, что, как они надеются, было исходным тестом.

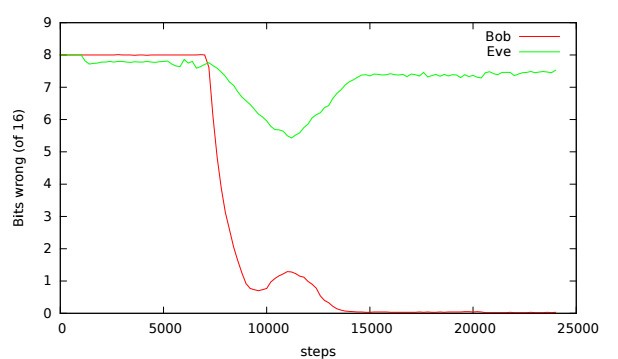

Реконструкция ошибок Боба и Евы во время испытаний. Можно видеть, что Ева начинает исправляться, но затем изменение криптометода Элис-Боба снова блокирует ее

Результаты были… яркими Некоторые попытки, когда Бобу так и не удавалось декодировать сообщение Элис, были полностью провалены. В большинстве случаев Элис и Бобу не удавалось разработать систему, внутри которой они могли общаться практически без ошибок. Во время некоторых тестов попытки случайного угадывания Евы были все ближе к истине, но Элис и Боб отвечали преобразованием криптографической техники, так что в конечном итоги у Евы не было шансов (см. график).

Исследователи не проводили исчерпывающего анализа методов шифрования, разработанных Евой и Бобом, но во время одного из тренировочных запусков было замечено, что эти методы зависели как от ключа, так и от исходного текста. «Однако они использовали не только исключающее ИЛИ. В частности, на выходе значения были с плавающей точкой, а не просто 0 и 1», – заявили исследователи.

В заключение, исследователи Мартин Абади и Дэвид Дж. Андерсен рассказали, что нейронные сети действительно способны научиться защищать свои сообщения, просто указывая Элис прежде всего соблюдать конфиденциальность. Еще важно то, что эту конфиденциальность можно обеспечить без предписания определенной последовательности алгоритмов шифрования.

Этот процесс ближе к криптографии, чем к просто симметричному шифрованию данных (с секретным ключом). Исследователи говорят о том, будущая работа могла бы быть нацелена на стеганографию (сокрытие данных внутри сторонних СМИ) и ассиметричное шифрование (с открытым ключом). На вопрос, сможет ли когда-нибудь Ева стать достойным противником, ученые ответили: «Пока кажется невероятным, чтобы нейронные сети научились великолепно анализировать криптоданные, но они могут довольно эффективно разбираться в метаданных и в анализе трафика».

Комментарии

Отличительная черта ИИ -- способность не только решать задачу, но и ставить её. В данном случае задачу ставил человек. Значит, ИИ нет и в помине. Но журналисты -- такие журналисты. Я про источник. :)

Хотя сообщение интересное.

PS Да, в источнике не "как это работает", а "никто не знает, как это работает". Не надо искажать. :))

Тут путаница. Речь, очеивдно, про нейросети идет но упор почему-то сделан на другое.

Я не специалист по ИИ, но по мне нейросеть вполне подходит под это определение. И статья интересная. А Ваши нападки на всех, господа, уже, как сами пишите, задралли. Своего интересного контента - ноль. Не профессия определяет человека, а отношение к жизни. Мне так даже неловко, что мы с вами (вроде) в одной сфере работаем, mike.

Что сказал, то сказал. Отличительная черта интеллекта, что реального, что искусственного -- см. выше. Иначе и червяк обладает интеллектом.